API da Cohere em Python: Um Guia Completo

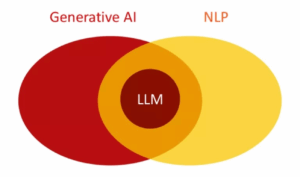

Os Modelos de Linguagem de Grande Porte (LLMs) multimodais representam uma mudança de paradigma na inteligência artificial, transcendendo o processamento de texto para integrar e raciocinar sobre um espectro de dados que incluem imagens, áudio, vídeo e código. Este estudo detalha, de forma técnica e embasada por instituições de referência como Google DeepMind, OpenAI, Meta AI e Stanford, as três áreas de impacto primordiais destes modelos:

LLMs multimodais transformam dados brutos e não estruturados em insights acionáveis e automação sofisticada. As soluções não são incrementais, mas sim disruptivas, habilitando capacidades anteriormente restritas ao domínio humano.

A principal vantagem de um LLM multimodal é sua capacidade de encontrar correlações em um espaço vetorial compartilhado, onde diferentes modalidades de dados são representadas.

O verdadeiro ponto é desbloqueado quando LLMs são capacitados a interagir com sistemas externos, criando fluxos de trabalho autônomos. Isso representa uma nova abordagem de programação que permite aos sistemas serem mais flexíveis e resolver problemas que antes eram difíceis de descrever em passos sequenciais.

O surgimento dos “Foundation Models“ (modelos de fundação) permitiu que qualquer pessoa possa ter suas próprias IAs de ponta e customizá-las para fazer qualquer coisa. Esses modelos generalistas servem de base e podem ser combinados com prompts e ferramentas adequadas para executar tarefas específicas no mundo real.

A inteligência artificial está evoluindo rapidamente, e um dos avanços mais impactantes é o desenvolvimento de agentes autônomos. Longe de serem apenas modelos que respondem a prompts, esses agentes são sistemas capazes de raciocinar, planejar e executar ações independentes em busca de um objetivo. Alimentados por LLMs multimodais, eles entendem o mundo através de diversas lentes (texto, imagem e áudio) e interagem com ferramentas e ambientes externos para resolver problemas complexos.

A arquitetura central desses agentes, muitas vezes baseada no ciclo ReAct (Reason + Act), permite que eles desconstruam grandes tarefas em etapas menores e gerenciáveis. Eles avaliam a situação, selecionam a ferramenta mais adequada (seja uma API de busca na web, um script Python para análise ou uma ferramenta de automação), executam a ação e, crucialmente, observam o resultado para ajustar seu próximo passo. Esse ciclo iterativo é o que lhes confere a capacidade de adaptação e resiliência em ambientes dinâmicos.

Para o mercado, isso significa uma automação sem precedentes. Imagine um agente de marketing digital que não apenas gera conteúdo, mas também pesquisa tendências, analisa o desempenho de campanhas concorrentes, cria vídeos e imagens e agenda postagens em diversas plataformas, tudo de forma autônoma. Ou um agente de RH que gerencia todo o processo de recrutamento, desde a triagem de currículos até o agendamento de entrevistas e a comunicação com os candidatos. A capacidade de um agente de orquestrar múltiplas ferramentas e raciocinar sobre dados heterogêneos o torna um vetor poderoso para a otimização de processos e a geração de valor em praticamente qualquer setor.

Vivemos na era dos dados, mas grande parte deles é não estruturada: textos em documentos, pixels em imagens, frequências em áudios. A verdadeira mina de ouro está em conectar esses pontos, e é aqui que entra a análise de dados multimodal com LLMs. Diferentemente dos métodos tradicionais que lidam com cada tipo de dado isoladamente, os LLMs multimodais possuem uma capacidade única de integrar e raciocinar sobre informações de diferentes modalidades simultaneamente.

Tecnicamente, isso é possível graças a um encoder unificado que projeta todos os tipos de dados, seja o texto de um relatório médico, a imagem de um exame ou o áudio de uma descrição de sintomas em um espaço de embeddings compartilhado. Nesse espaço, correlações e padrões que seriam invisíveis para sistemas monomodais se tornam evidentes. Isso significa que um LLM pode, por exemplo, correlacionar o som incomum de uma máquina industrial capturado por um microfone com uma imagem de uma peça defeituosa vista por uma câmera, e ainda cruzar essas informações com o manual de manutenção textual daquele equipamento.

As aplicações são vastas e impactantes:

Essa capacidade de transformar “ruído” heterogêneo em insights acionáveis é um diferencial competitivo que impulsiona a inovação e a tomada de decisões mais inteligentes.

Enquanto um único agente autônomo é essencial, o verdadeiro potencial disruptivo surge quando múltiplos agentes colaboram, cada um com sua especialidade, em um sistema orquestrado. Pense neles como uma equipe de especialistas, cada um com um conjunto de habilidades e ferramentas específicas, trabalhando em conjunto para resolver um problema que seria impossível para um único indivíduo ou sistema.

A orquestração de múltiplos agentes permite dividir problemas complexos em subtarefas, delegando-as aos agentes mais aptos. Por exemplo, em um cenário de criação de conteúdo:

Essa colaboração entre agentes, mediada por um LLM central ou por uma estrutura de comunicação entre eles, leva a soluções mais robustas e eficientes. Frameworks como LangChain ou CrewAI facilitam a criação e o gerenciamento dessas “equipes de IA”, permitindo que os agentes se comuniquem, compartilhem resultados e até mesmo corrijam uns aos outros, simulando um fluxo de trabalho colaborativo humano. A implementação de múltiplos agentes é um passo importante para a automação de ponta a ponta de processos de negócio, elevando a capacidade de resolução de problemas a um novo patamar.

Para aplicar LLMs de forma eficaz, é importante compreender sua arquitetura e os métodos de aprendizado. Para entender como as LLMs funcionam, é fundamental compreender a arquitetura de redes neurais, que são a base da IA moderna.

O artigo seminal “Attention Is All You Need” (Vaswani et al., 2017) introduziu a arquitetura Transformer, que é a espinha dorsal de todos os LLMs modernos e se destaca pela capacidade de entender relações de longo prazo na linguagem.

1. Mecanismo de atenção (Attention Mechanism): a atenção permite que o modelo pese a importância de diferentes partes da entrada ao processar uma informação específica. Em um contexto multimodal, a atenção pode correlacionar um objeto em uma imagem com uma palavra específica na legenda.

Matematicamente, a atenção é calculada como: $$ $$$$text{Attention}(Q, K, V) = text{softmax}left(frac{QK^T}{sqrt{d_k}}right)V $$ $$$$

Onde Q (Query), K (Key) e V (Value) são projeções vetoriais da entrada. Este mecanismo permite ao modelo “focar” no que é relevante.

2. Mecanismos internos: dentro de um Transformer, as operações envolvem tokenização (transformar palavras em números), incorporação (associar cada token a um vetor de alta dimensão que codifica significado), blocos de atenção (permitindo que os vetores se comuniquem e absorvam contexto) e perceptrons multicamadas (MLPs ou camadas feed-forward) para armazenamento de padrões e fatos.

O aprendizado das redes neurais envolve a minimização de uma função de custo, que mede o quão “ruim” é o desempenho da rede em dados de treinamento. Isso é feito ajustando os pesos e vieses do modelo através de algoritmos como a descida do gradiente (Gradient Descent), utilizando o algoritmo de retropropagação (backpropagation) para calcular o gradiente eficientemente.

Um modelo pré-treinado é poderoso, mas genérico. A especialização para tarefas do mundo real ocorre principalmente de duas formas:

| Estratégia | Descrição Técnica | Vantagens | Desvantagens |

| Retrieval-Augmented Generation (RAG) |

|

|

|

| Fine-Tuning (Ajuste Fino) |

|

|

|

Recomendação institucional (McKinsey, a16z): para a maioria das aplicações corporativas que dependem de conhecimento proprietário e atualizado, uma arquitetura híbrida baseada em RAG é o ponto de partida ideal. O Fine-Tuning é reservado para tarefas que exigem a adaptação do comportamento central do modelo.

Além disso, o Prompt tuning é uma técnica mais eficiente que usa soft prompts (sequências de números geradas por IA, imperceptíveis ao olho humano) inseridas na camada de embedding do modelo para guiá-lo a uma decisão ou previsão desejada para uma tarefa específica, sem a necessidade de grandes volumes de dados ou retreinamento.

A monetização da IA ocorre em diferentes camadas de abstração, com a maior oportunidade residindo na camada de aplicação.

As LLMs multimodais não são apenas uma ferramenta, mas um novo stack computacional. Elas permitem que problemas antes intratáveis, que exigiam cognição humana interdisciplinar, sejam abordados de forma sistemática e escalável.

O valor econômico e estratégico não está em simplesmente usar os modelos, mas em orquestrá-los com dados proprietários e ferramentas externas para criar soluções verticais que resolvam dores de mercado específicas e de alto valor.

A nova fronteira competitiva reside na criatividade e na engenhosidade para construir esses sistemas integrados, que atuam como poderosos assistentes que impulsionam a produtividade.

Aprenda a programar e desenvolva soluções para o seu trabalho com Python para alcançar novas oportunidades profissionais. Aqui na Asimov você encontra:

Comentários

30xp