Se você usa o ChatGPT, Gemini ou Claude no dia a dia, provavelmente já sentiu isso no bolso. Cada ferramenta cobra sua própria assinatura e, quando você soma tudo no fim do mês, a conta começa a ficar bem menos leve do que parecia no início.

Agora, imagine usar vários modelos de IA em uma única interface, com mais controle, mais privacidade e pagando apenas pelo que realmente consumir.

É exatamente essa a proposta do OpenWebUI.

Neste artigo, você vai entender o que é o OpenWebUI, como instalar, como conectar modelos locais e externos, quais recursos ele oferece e por que ele pode ser uma alternativa muito mais interessante do que sair assinando várias ferramentas separadas.

O que é o OpenWebUI

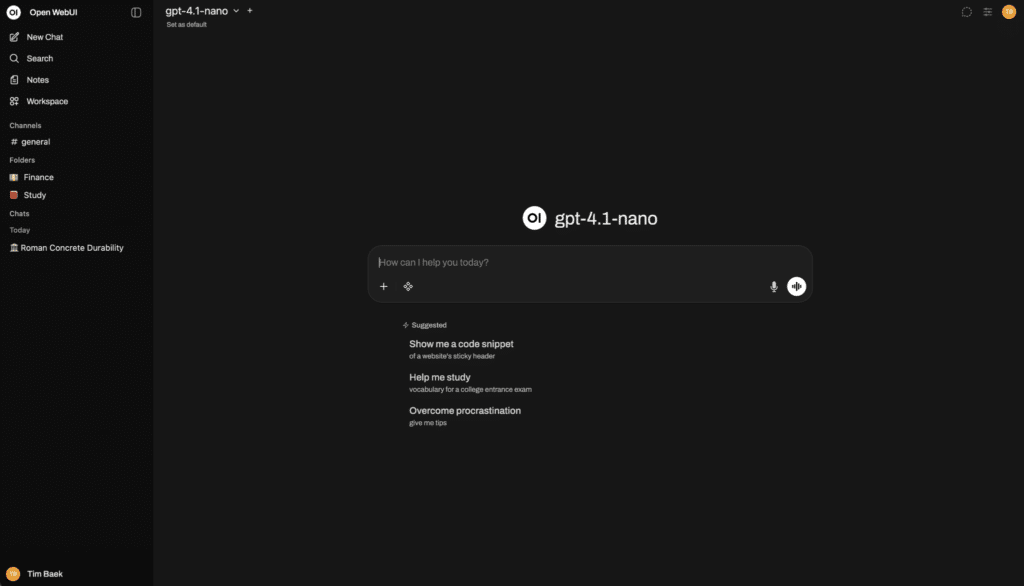

O OpenWebUI é uma interface web open source para trabalhar com modelos de linguagem de forma centralizada. Ele é um ambiente visual, semelhante ao ChatGPT, que permite conversar com diferentes IAs, organizar chats, usar documentos como base de conhecimento, ativar ferramentas extras e controlar usuários dentro do mesmo sistema.

A grande diferença é que ele não depende de um único modelo nem de uma única empresa. Você pode usar o OpenWebUI para conversar com modelos locais, rodando diretamente na sua máquina com Ollama, ou com modelos pagos acessados por API, como GPT, Claude e Gemini.

Na prática, isso significa que o OpenWebUI pode virar o teu “painel central” para IA.

Com ele, você consegue:

- Conversar com diferentes modelos em uma única interface;

- Usar modelos locais offline;

- Conectar APIs externas;

- Subir documentos e conversar com eles;

- Executar código;

- Ativar busca na web;

- Organizar usuários, grupos e permissões.

Ou seja, ele é uma camada de controle sobre como você usa inteligência artificial no dia a dia.

Por que usar o OpenWebUI

Essa centralização das suas IAs no OpenWebUI chama atenção por três motivos principais:

1. Economia

Quando você usa a interface tradicional de um chatbot, normalmente paga uma assinatura fixa por mês. Já no OpenWebUI, você pode usar APIs e pagar por consumo. Para a maior parte das pessoas, isso tende a sair mais barato do que manter várias mensalidades ao mesmo tempo.

2. Privacidade

Se você usa modelos locais com Ollama, os dados podem ficar inteiramente na sua máquina. Isso é relevante para quem já trabalha com informação sensível ou quer mais controle sobre o que está sendo enviado para fora.

3. Flexibilidade

E por último, em vez de adaptar seu fluxo à ferramenta, você passa a adaptar a ferramenta ao seu fluxo. Isso muda bastante a experiência, especialmente para quem quer comparar modelos, organizar documentos, criar uma base de prompts ou oferecer acesso para outras pessoas do time.

Para fechar, o Professor Rodrigo conta por que decidiu cancelar o ChatGPT e por que o OpenWebUI virou sua nova escolha:

Como instalar o OpenWebUI

A forma mais prática de instalar o OpenWebUI é com o Docker. Essa é, inclusive, a abordagem mais recomendada para quem quer subir a aplicação de forma rápida e manter os dados persistidos corretamente.

Antes de começar, você precisa ter:

- Docker instalado na máquina;

- Terminal funcionando normalmente;

- Opcionalmente, Ollama já instalado, se quiser usar modelos locais.

Docker: a solução para ambientes de desenvolvimento

Instalação rápida com Docker

O processo mais direto envolve dois passos.

Primeiro, baixar a imagem oficial:

docker pull ghcr.io/open-webui/open-webui:mainDepois, subir o container:

docker run -d -p 3000:8080 -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:mainEsse segundo comando já resolve o essencial:

- Disponibiliza a interface localmente;

- Cria um volume persistente para armazenar histórico, configurações e dados.

Esse detalhe do volume é importante. Sem ele, você pode correr o risco de perder conversas e configurações ao remover ou atualizar o container.

Containers: transformando o desenvolvimento em Python

Como acessar

Depois que a aplicação estiver rodando, basta abrir o navegador em: http://localhost:3000

No primeiro acesso, você cria a conta inicial de administrador. A partir daí, a interface já fica pronta para uso.

Usando docker-compose

Se você prefere uma instalação mais organizada, principalmente para atualizar ou reproduzir o ambiente depois, vale usar um docker-compose.yml.

Exemplo:

services:

openwebui:

image: ghcr.io/open-webui/open-webui:main

ports:

- "3000:8080"

volumes:

- open-webui:/app/backend/data

volumes:

open-webui:Esse formato costuma ser mais confortável quando você quer deixar a configuração salva e reutilizável.

Como usar o OpenWebUI com modelos locais

Uma das integrações mais interessantes do OpenWebUI é com o Ollama. Se você já conhece essa ferramenta, sabe que ela permite rodar modelos de linguagem localmente, direto na sua máquina.

Quando o OpenWebUI é conectado ao Ollama, ele passa a funcionar como uma interface visual para esses modelos. Em vez de interagir pelo terminal, você passa a usar uma experiência bem mais amigável, parecida com os chats atuais como Gemini, DeepSeek e Claude. Isso abre um cenário muito prático para:

- Rodar modelos locais;

- Manter dados mais privados;

- Usar a interface do OpenWebUI como ponto central;

- Evitar depender exclusivamente de provedores externos.

Para quem quer mais controle ou trabalha em ambientes onde privacidade importa bastante, essa combinação faz muito sentido.

Como conectar modelos pagos por API

Além dos modelos locais, o OpenWebUI também pode ser conectado a APIs compatíveis com o padrão da OpenAI. Isso permite usar modelos pagos dentro da mesma interface, sem precisar alternar entre várias abas ou plataformas.

Na prática, o fluxo costuma ser simples:

- Criar conta de desenvolvedor no provedor desejado;

- Gerar a chave de API;

- Colar essa chave nas configurações do OpenWebUI;

- Selecionar o modelo na interface.

A partir daí, os modelos passam a aparecer dentro do ambiente, lado a lado com os demais.

É justamente esse modo de uso que permite pagar por consumo, em vez de pagar uma assinatura fixa mensal. Dependendo do seu padrão de uso, isso pode representar uma boa economia.

Modelos de IA: o que são, tipos, aplicações e como funcionam na prática

OpenWebUI vs ChatGPT vs Claude: quais são as diferenças?

À primeira vista, OpenWebUI, ChatGPT e Claude podem parecer ferramentas muito parecidas. Afinal, todas permitem conversar com modelos de inteligência artificial e gerar respostas para perguntas, textos ou códigos.

Mas, na prática, elas têm propostas bem diferentes.

ChatGPT e Claude são plataformas prontas, criadas por empresas específicas (OpenAI e Anthropic). Você acessa a interface delas diretamente pelo navegador e utiliza os modelos que a própria empresa disponibiliza.

Claude IA: o que é, como funciona e como usar no dia a dia

Já o OpenWebUI funciona de outra forma. Ele não é um modelo de IA, mas sim uma interface que permite usar vários modelos diferentes no mesmo lugar. Em vez de depender de uma única empresa, você pode conectar modelos locais, APIs externas ou até múltiplos provedores ao mesmo tempo.

Isso significa que o OpenWebUI oferece mais flexibilidade e controle, enquanto ferramentas como ChatGPT e Claude focam em uma experiência mais simples e pronta para uso.

As principais diferenças entre essas três opções:

| Característica | OpenWebUI | ChatGPT | Claude |

| Tipo de ferramenta | Interface open source para múltiplos modelos | Plataforma de IA da OpenAI | Plataforma de IA da Anthropic |

| Modelos disponíveis | Pode conectar vários modelos (GPT, Claude, Llama, Gemini, etc.) | Modelos da OpenAI | Modelos da Anthropic |

| Instalação | Pode ser instalado localmente ou em servidor | Uso direto pelo navegador | Uso direto pelo navegador |

| Uso offline | Sim, com modelos locais via Ollama | Não | Não |

| Integração com APIs | Sim | Limitado na interface | Limitado na interface |

| Controle de dados | Alto controle (especialmente local) | Dados passam pela OpenAI | Dados passam pela Anthropic |

| Comparação entre modelos | Sim, na mesma interface | Não | Não |

| Gestão de usuários | Sim | Limitado | Limitado |

| Modelo de pagamento | Geralmente por consumo (API) | Assinatura mensal | Assinatura mensal |

Na prática, a escolha entre essas ferramentas depende muito do seu objetivo.

Se você quer simplicidade e começar rápido, plataformas como ChatGPT e Claude são ótimas opções.

Por outro lado, se você quer mais controle, flexibilidade e acesso a vários modelos ao mesmo tempo, o OpenWebUI pode ser uma solução muito mais ideal para você.

Ferramentas do OpenWebUI: web search, código e mais

Outro ponto forte do OpenWebUI é que a interface pode ser expandida com ferramentas que deixam o ambiente muito mais útil para trabalho real.

Busca na web

Com a busca na web ativada, o modelo consegue consultar informações atualizadas antes de responder. Isso é importante porque muitos modelos, por padrão, operam com conhecimento congelado.

Execução de código

O recurso de interpretador de código é ideal para quem trabalha com Python, dados ou automação. Em vez de só pedir uma explicação, você consegue usar o ambiente para testar pequenos scripts e explorar resultados.

Geração de imagens

Dependendo da configuração e dos backends conectados, o OpenWebUI também pode servir como ponto de acesso para geração de imagens.

Multimodalidade: texto, imagem e documentos no mesmo ambiente

Uma outra razão para o OpenWebUI chamar tanta atenção é justamente o fato de ele não se limitar a um único formato de interação.

Na prática, ele pode concentrar:

- texto;

- documentos;

- imagens;

- memória;

- ferramentas;

- bases de conhecimento.

Isso muda bastante a percepção da ferramenta. Ela deixa de ser apenas uma interface de chat e começa a se parecer mais com um ambiente operacional para trabalhar com IA.

Vale a pena usar o OpenWebUI?

Na maioria dos casos, sim.

Ele faz mais sentido para quem se encaixa em pelo menos um destes perfis:

Quem quer reduzir custo com IA

Se você usa múltiplos modelos, mas não tem um volume gigantesco de consumo, pagar por API pode fazer bem mais sentido do que manter várias assinaturas mensais.

Quem quer mais privacidade

Rodar modelos locais, com interface própria, é uma vantagem real para quem quer mais controle sobre os dados.

Quem quer centralizar o fluxo de trabalho

Em vez de espalhar chats, prompts, documentos e ferramentas por várias plataformas, você concentra tudo em um único ambiente.

O principal ponto de atenção é que ele exige um pouco mais de conforto técnico na instalação inicial. Mas, depois disso, a experiência tende a ser muito mais flexível do que depender só de ferramentas fechadas.

Quer ir além do OpenWebUI?

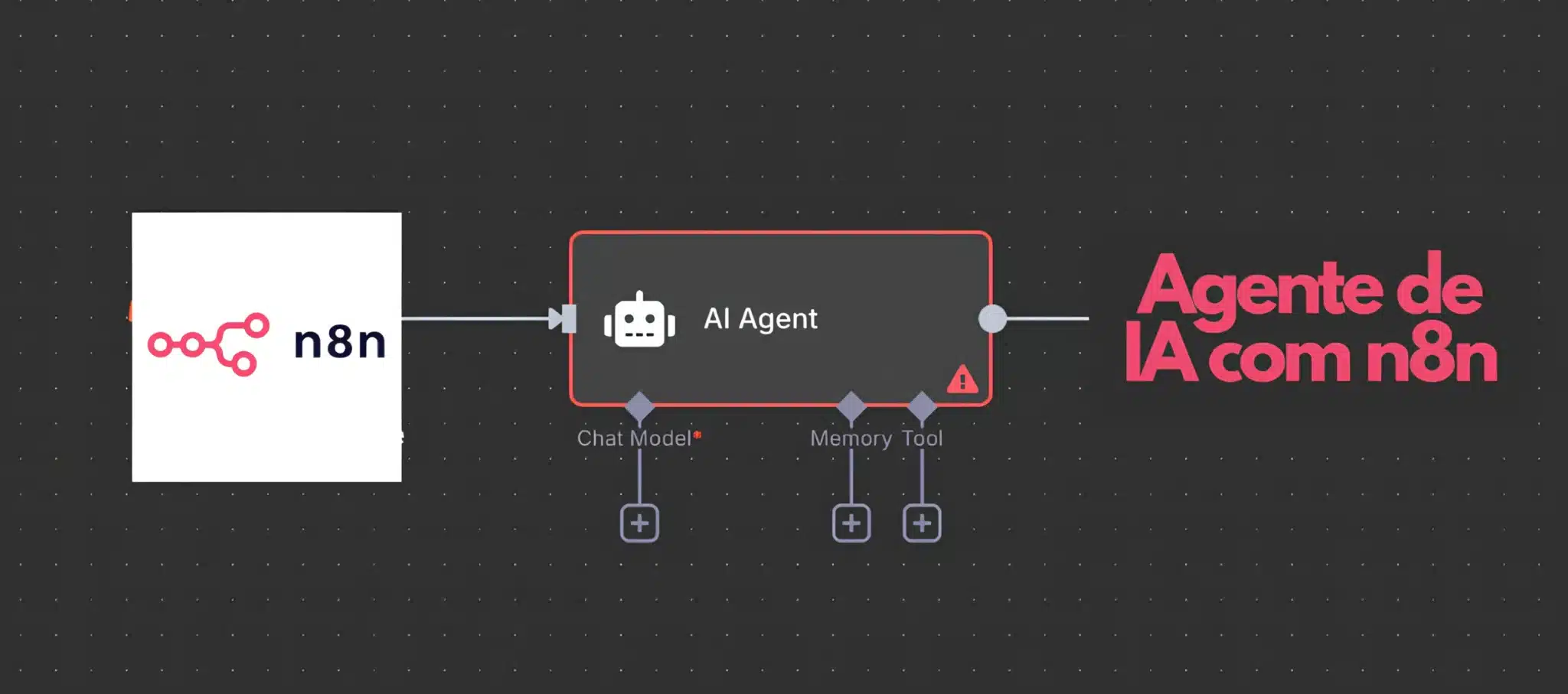

Usar o OpenWebUI já é um ótimo passo. Mas ele é só uma parte do que hoje dá para construir com modelos de linguagem, agentes e automações.

Se você quer sair do uso superficial de IA e aprender a criar aplicações reais, vale conhecer a Formação Agente de IA da Asimov Academy.

Nela, você aprende a:

- Trabalhar com modelos de linguagem na prática;

- Construir agentes com Python;

- Integrar ferramentas externas;

- Criar soluções reais para uso pessoal ou profissional.

Ou seja, em vez de só usar AI, você começa a construir elas pro seu tipo de projeto e utilidade.

Formação Engenheiro de Agentes de IA

Domine os frameworks de criação de agentes de IA mais avançados da atualidade e aprenda a transformar qualquer LLM em um agente!

Comece agora

Cursos de programação gratuitos com certificado

Aprenda a programar e desenvolva soluções para o seu trabalho com Python para alcançar novas oportunidades profissionais. Aqui na Asimov você encontra:

- Conteúdos gratuitos

- Projetos práticos

- Certificados

- +20 mil alunos e comunidade exclusiva

- Materiais didáticos e download de código

Comentários

30xp