As melhores IA para criar imagem em 2026

O Llama 3 é um avanço notável na inteligência artificial (IA), um modelo de linguagem de código aberto que está chamando a atenção por suas capacidades impressionantes. A IA está em constante evolução, e a cada nova geração de modelos, somos apresentados a inovações que prometem transformar a forma como interagimos com a tecnologia. Neste artigo, vamos explorar o que é o Llama 3, como ele funciona, suas aplicações práticas e o que podemos esperar para o futuro da IA com essa tecnologia.

Mas antes, que tal assistir a este vídeo do YouTube? Ele explica de forma rápida o que é o Llama 3 e por que ele é considerado o maior modelo de linguagem atualmente:

O Llama 3 é um modelo de linguagem de código aberto que foi projetado para ser mais eficiente do que as versões anteriores, como o Llama 2. Ele é capaz de processar grandes volumes de dados, gerar respostas coerentes e contextualmente relevantes, além de realizar tarefas repetitivas, automatizar processos complexos e criar conteúdo para tradução. Essas e outras capacidades tornam o Llama 3 uma ferramenta valiosa para uma variedade de aplicações, desde chatbots até assistentes virtuais. Ele foi desenvolvido pela Meta para ser um modelo de linguagem de grande escala que utiliza inteligência artificial para entender e gerar texto de forma semelhante a um humano.

Se você está curioso sobre como o Llama 3 opera, vamos simplificar. Ele é um modelo de linguagem avançado, capaz de aprender e entender padrões a partir de grandes volumes de texto. Sua arquitetura é do tipo decoder-only, comum em muitos modelos modernos, permitindo que ele processe informações de maneira eficiente. Além disso, o Llama 3 vem em duas versões principais, com 8 bilhões (8B) e 70 bilhões (70B) de parâmetros, o que o torna capaz de realizar tarefas desde geração de texto até raciocínios complexos e até codificação. Esse poder de processamento o coloca entre os melhores modelos de IA disponíveis atualmente.

Outro aspecto importante é a sua tokenização avançada. Com um vocabulário de 128 mil tokens, ele consegue quebrar e interpretar o texto de maneira mais eficiente, usando até 15% menos tokens em comparação ao Llama 2. Isso melhora significativamente o desempenho, permitindo que ele processe mais informações em menos tempo. Para tornar o aprendizado ainda mais eficaz, o Llama 3 foi treinado com técnicas como PPO (Proximal Policy Optimization) e DPO (Direct Preference Optimization), que aprimoram sua capacidade de selecionar respostas corretas, especialmente em tarefas que envolvem raciocínio lógico.

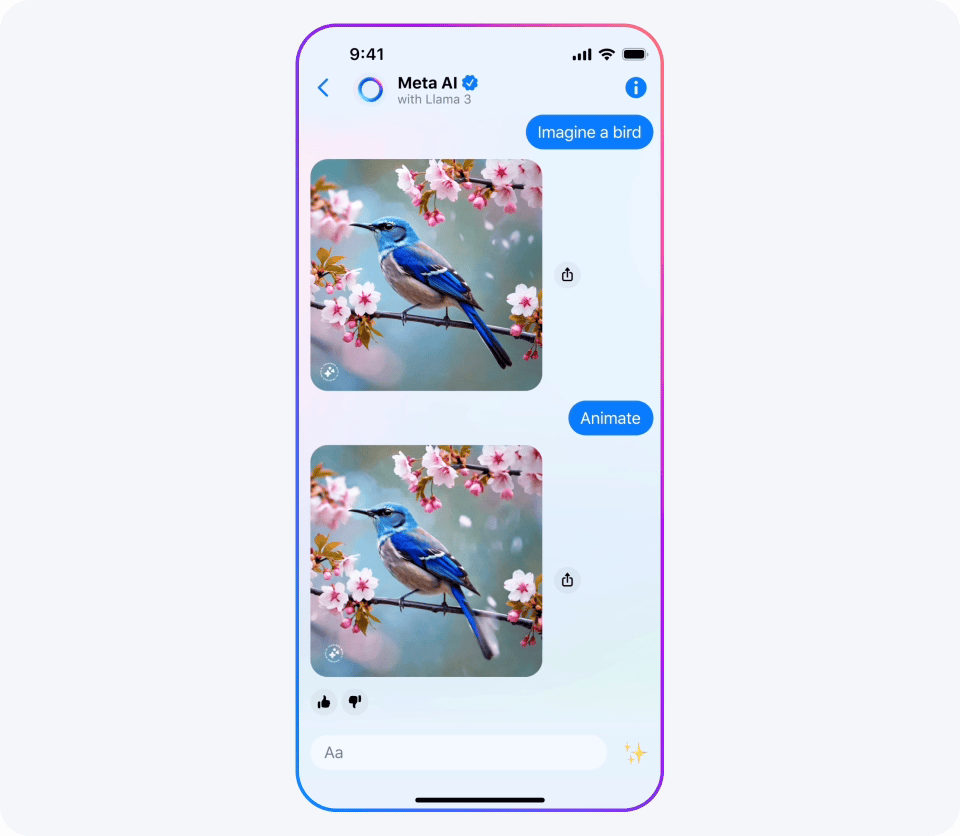

Mas o Llama 3 não se limita ao texto: ele também pode gerar imagens em tempo real a partir de descrições textuais, uma função que já está sendo implementada em plataformas como WhatsApp e Instagram. Essa capacidade de transformar texto em imagens torna a interação com o modelo muito mais imersiva e prática.

Embora as versões de 8B e 70B de parâmetros já estejam disponíveis e sejam de código aberto, uma versão ainda maior, de 400B, está em desenvolvimento, prometendo um desempenho ainda mais impressionante. Com todas essas inovações, o Llama 3 se destaca como um dos modelos de IA generativa mais poderosos e acessíveis da atualidade.

O Llama 3 se diferencia bastante de seus antecessores, especialmente no que diz respeito à sua capacidade de processamento e eficiência. Com um desempenho superior, ele foi projetado para lidar com tarefas mais complexas e exigentes, o que o torna mais versátil em uma variedade maior de plataformas e dispositivos.

Abaixo, você encontra as principais diferenças entre o Llama 3 e o Llama 2:

| Característica | Llama 2 | Llama 3 |

| Número de parâmetros | 7B, 13B, 70B | 8B, 70B, 405B |

| Dados de treinamento | 2 trilhões de tokens | 15 trilhões de tokens |

| Comprimento do contexto | 4.096 tokens | 8.192 tokens |

| Mecanismo de atenção | Atenção padrão | Atenção por consultas agrupadas (GQA) |

| Capacidades multimodais | Principalmente texto | Planejado para multimodalidade (texto e imagem) |

| Desempenho em tarefas | Bom, mas limitado | Superior em benchmarks como MMLU, ARC e DROP |

| Acessibilidade | Disponível em várias plataformas | Disponível em plataformas de nuvem como AWS e Google Cloud |

Uma das principais diferenças entre os dois modelos que encontramos na tabela é o volume de dados utilizados em seu treinamento. O Llama 3 foi treinado com um impressionante conjunto de dados de 15 trilhões de tokens, enquanto o Llama 2 utilizou apenas 2 trilhões. Essa diferença permite que o Llama 3 tenha uma compreensão mais aprofundada das linguagens e seja capaz de fornecer respostas mais precisas para consultas complexas.

Outro ponto de destaque do Llama 3 é o seu desempenho em tarefas que envolvem raciocínio lógico e geração de código. Graças às melhorias na arquitetura e nas técnicas de treinamento, ele supera o Llama 2 em vários benchmarks, tornando-se uma escolha ideal para projetos que exigem soluções mais robustas e inteligentes. Isso significa que ele não só processará entradas textuais, mas também aceitará imagens, gráficos e outros tipos de dados.

E agora tem NOVA IA: LLAMA 3.1 que a Meta lançou, neste vídeo o Prof. Rodrigo, te conta tudo sobre a nova Llama 3.1 de 405 bilhões de parâmetros.

As possibilidades de uso do Llama 3 são enormes e supervariadas. No seu dia a dia, ele pode ser integrado em chatbots, tornando as conversas muito mais naturais e fluidas. Sabe aquele assistente virtual que você usa? Com o Llama 3, ele não só responde perguntas, mas entende o contexto, dando sugestões certeiras e tornando a interação bem mais envolvente.

Imagina ter um assistente virtual que realmente entende o que você precisa e vai além, sugerindo coisas que você nem pediu, mas que fazem todo sentido? O Llama 3 faz isso acontecer!

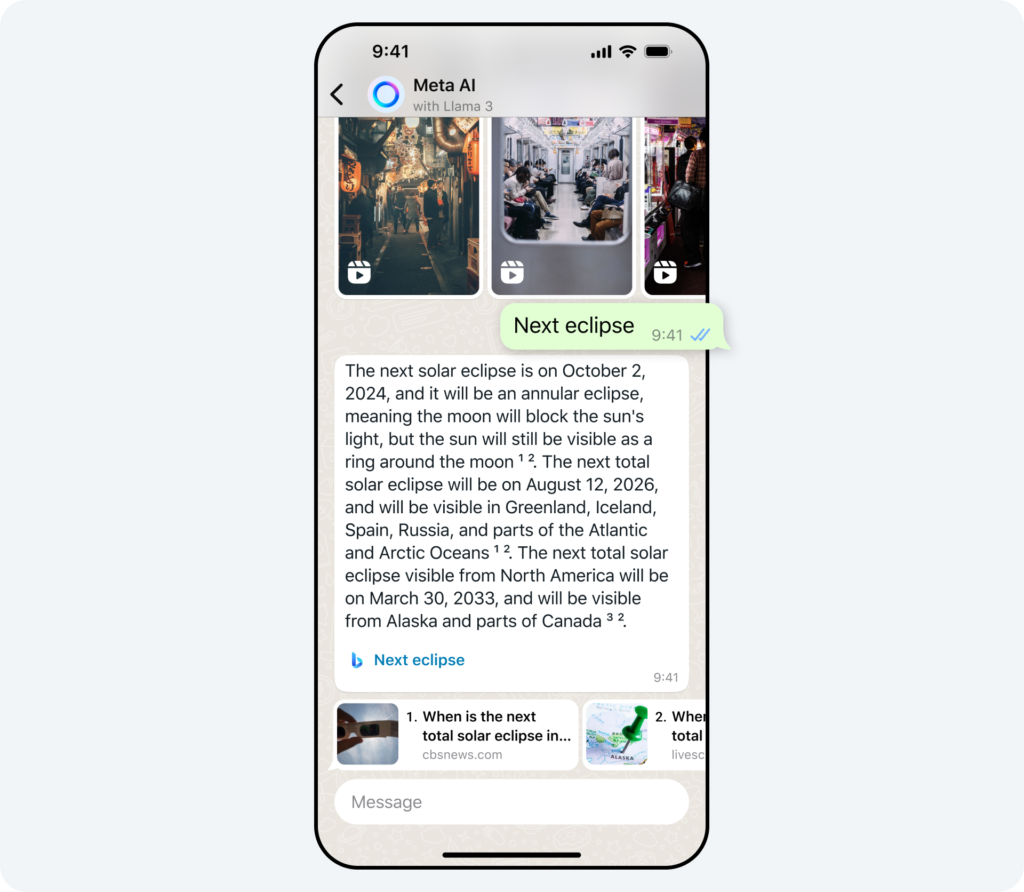

No WhatsApp e Messenger, ele ajuda estudantes com explicações detalhadas de diversos assuntos, desde matemática até a revisão de textos. Esqueça horas de busca no Google ou vídeos confusos, o Llama 3 te ajuda a aprender de forma prática e personalizada, na palma da sua mão.

Com descrições textuais, o Llama 3 pode criar imagens superdetalhadas no WhatsApp. Essa funcionalidade incrível está sendo expandida para outras plataformas da Meta e dá uma nova cara à experiência dos usuários, deixando tudo mais interativo.

O Llama 3 também auxilia na geração de código, sendo uma mão na roda para desenvolvedores que precisam de soluções rápidas. Isso aumenta muito a produtividade, porque ajuda a resolver problemas na hora.

Ele pode criar dados sintéticos para treinar outros modelos menores. Ideal para quem precisa de dados, mas não tem acesso a eles de maneira fácil.

Com suporte para vários idiomas, o Llama 3 permite criar agentes que podem atender pessoas do mundo inteiro, melhorando a comunicação e acessibilidade global.

Se você está pensando em aproveitar o potencial do Llama 3, mas não sabe bem por onde começar, fica tranquilo, o processo é mais acessível do que parece. A melhor parte é que várias plataformas já suportam essa tecnologia, facilitando bastante a implementação, seja para projetos pessoais, seja para soluções empresariais mais elaboradas. O Llama 3 oferece flexibilidade e recursos, os quais podem ser usados para uma ampla gama de aplicações, desde assistentes virtuais até soluções de geração de código.

Antes de tudo, vale a pena garantir que você tenha os requisitos adequados, como hardware apropriado e um ambiente de desenvolvimento bem configurado. Não se preocupe se isso parecer complicado! Vamos te mostrar o passo a passo para começar a usar o Llama 3 de maneira simples e, se preferir, também há plataformas online que permitem testar o modelo sem precisar configurar nada localmente.

Para usar o Llama 3 com desempenho ideal, recomenda-se ter uma GPU com pelo menos 16 GB de memória. Se você planeja usar os modelos maiores, como o Llama 3 70B, talvez precise de várias GPUs. Quanto ao sistema operacional, o Linux é geralmente o preferido para a configuração de ambientes de machine learning, devido à sua estabilidade e compatibilidade com as bibliotecas necessárias.

O próximo passo é acessar o site da Meta AI e baixar o modelo. As opções variam de modelos menores, como o de 8B, até os mais poderosos, como o de 70B. Dependendo das suas necessidades, você pode escolher entre versões pré-treinadas ou ajustadas por instrução. Ambas são ótimas para diferentes tipos de uso.

Agora que você já tem o modelo, é hora de preparar o ambiente de desenvolvimento. A instalação de bibliotecas necessárias é supersimples com o pip, o gerenciador de pacotes do Python. Bibliotecas como o LangChain e o vLLM facilitam a integração do Llama 3 em seus projetos, tornando a utilização do modelo muito mais fluida. Você pode instalar com o comando:

pip install vllm langchainCom o ambiente pronto, é hora de ver o Llama 3 em ação! Abaixo, um exemplo simples de como usar um script em Python para carregar o modelo e fazer uma interação básica:

from langchain_community.llms import LlamaCpp

# Carregar o modelo

llm = LlamaCpp(model_path="caminho/para/o/modelo/Meta-Llama-3-8B-Instruct-Q3_K_L.gguf", max_tokens=100, n_ctx=512)

# Fazer uma pergunta

response = llm.invoke("Quais são os melhores amigos do Mickey Mouse?")

print(response)Se a ideia de configurar tudo localmente te parece trabalhoso, você pode começar a usar o Llama 3 em plataformas online ou em serviços de nuvem que oferecem suporte completo para essa tecnologia. Aqui estão algumas opções:

O futuro do Llama 3 promete ser ainda mais empolgante do que imaginamos. Recentemente, a Meta anunciou que os modelos Llama 3 8B e 70B estão apenas começando a mostrar o que estão preparados para fazer, e isso é apenas a ponta do iceberg. Nos próximos meses, podemos esperar uma série de inovações que vão transformar ainda mais a forma como interagimos com a inteligência artificial. Imagine modelos com mais de 400 bilhões de parâmetros, que ainda estão em fase de treinamento, mas que já estão apresentando um desempenho incrível.

Entre as novas funcionalidades que estão a caminho, destacam-se a multimodalidade, permitindo que o Llama 3 processe não apenas texto, mas também imagens e outros dados. Além disso, haverá suporte para múltiplos idiomas, o que tornará a interação muito mais inclusiva e acessível. Outro aspecto que vai fazer a diferença é a ampliação da janela de contexto, que permitirá que o modelo processe informações mais extensas em uma única conversa, resultando em diálogos muito mais naturais e coerentes.

O que realmente impressiona é a abordagem da Meta em construir um ecossistema aberto de IA. Conforme anunciado pela empresa, acredita-se que a abertura é essencial para criar produtos melhores e mais seguros, promover inovações rápidas e desenvolver um mercado global mais saudável. Então, a partir de agora, os modelos Llama 3 estarão disponíveis nas principais plataformas de nuvem, hospedagem e hardware, com muitas outras opções a caminho. Certamente, essa decisão não só beneficia a Meta, mas também contribui para a sociedade como um todo, permitindo que mais pessoas tenham acesso a essas tecnologias avançadas.

Assim, à medida que avançamos para o futuro do Llama 3, as promessas de inclusão, inovação e responsabilidade social são uma constante. E você, como parte dessa jornada, terá a oportunidade de explorar todo o potencial que essa tecnologia oferece.

Se você sempre quis entender inteligência artificial, mas achou que isso era algo “só para programadores”, aqui está a chance de mudar essa ideia. Não importa se você nunca programou uma linha de código na vida, o curso gratuito Python para IA: do zero ao primeiro chatbot, da Asimov Academy, foi feito justamente para você.

Esse curso te guia de forma simples e prática, mostrando que aprender IA não é um bicho de sete cabeças. Imagine poder automatizar tarefas e criar soluções inovadoras, tudo com Python, uma linguagem extremamente acessível!

E o melhor: você vai sair do curso com um projeto nas mãos, um chatbot capaz de interagir com dados reais, como sites, PDFs e até vídeos do YouTube. Com as aulas, você aprenderá a usar a biblioteca LangChain para transformar ideias em ferramentas reais, úteis no seu dia a dia.

Porque esse curso foi feito pensando em quem nunca teve contato com programação e quer aprender do jeito certo, sem complicação. Ao final, você terá habilidades práticas que vão além do básico e que podem ser um grande diferencial na sua carreira.

Se destaque no mercado, comece agora a explorar o mundo da IA de uma forma prática e descomplicada. Clique neste card abaixo e inscreva-se gratuitamente!

Vá do zero ao primeiro projeto em apenas 2 horas com o curso Python para Iniciantes.

Comece agoraEsse pode ser o primeiro passo para transformar sua relação com tecnologia e mudar sua realidade.

Aprenda a programar e desenvolva soluções para o seu trabalho com Python para alcançar novas oportunidades profissionais. Aqui na Asimov você encontra:

Comentários

30xpExcelente post!

Valeu demais, Thales! Se curtiu esse conteúdo, dá uma olhada nos cursos da Asimov que mencionamos no final do post 🚀