Se você está começando a explorar o fascinante mundo da Inteligência Artificial (IA), provavelmente já ouviu falar da Hugging Face. Mas o que exatamente é essa plataforma e por que ela se tornou tão popular?

Neste guia, vamos desvendar tudo sobre a Hugging Face, suas ferramentas e como você pode utilizá-las em seus projetos de IA, especialmente se você é um iniciante em Python. Prepare-se para uma jornada que vai te ajudar a entender como a Hugging Face pode ser uma aliada poderosa na sua aprendizagem e desenvolvimento em IA!

O que é a Hugging Face?

Você já ouviu falar na Hugging Face? Ela começou em 2016, inicialmente focada em chatbots, mas logo se reinventou e se tornou uma referência em ferramentas de processamento de linguagem natural (PLN). Hoje, a Hugging Face é conhecida pela biblioteca Transformers, que oferece uma enorme variedade de modelos pré-treinados para diversas tarefas de inteligência artificial.

A empresa nasceu como uma startup na França e, rapidamente, ganhou destaque no mundo da IA graças à sua abordagem colaborativa e ao compromisso de democratizar o acesso a tecnologias avançadas. Com o apoio de grandes investidores como Google e Amazon, ela se transformou em uma plataforma essencial para desenvolvedores e pesquisadores que querem explorar as possibilidades da IA.

Um dos principais objetivos da Hugging Face é tornar a inteligência artificial acessível a todos. A plataforma disponibiliza uma série de recursos gratuitos, permitindo que até mesmo pessoas sem experiência em programação possam utilizar modelos de IA de maneira simples e intuitiva. Em um campo que, historicamente, era dominado por especialistas e grandes empresas, isso faz toda a diferença.

Funciona de um jeito parecido com o GitHub, onde você pode compartilhar seus projetos, buscar inspiração ou até mesmo clonar trabalhos de outras pessoas. No momento em que este texto foi escrito, já existem mais de 850 mil modelos disponíveis na plataforma, capazes de lidar com processamento de texto, áudio e imagem.

Principais componentes da plataforma Hugging Face

Hugging Face começou com chatbots, mas hoje é referência global em IA. Sua biblioteca transformers se tornou essencial para tarefas como tradução automática, criação de textos e análise de sentimentos. Além disso, a plataforma funciona como um hub colaborativo, reunindo entusiastas e profissionais para compartilhar modelos, bases de dados e aplicações práticas.

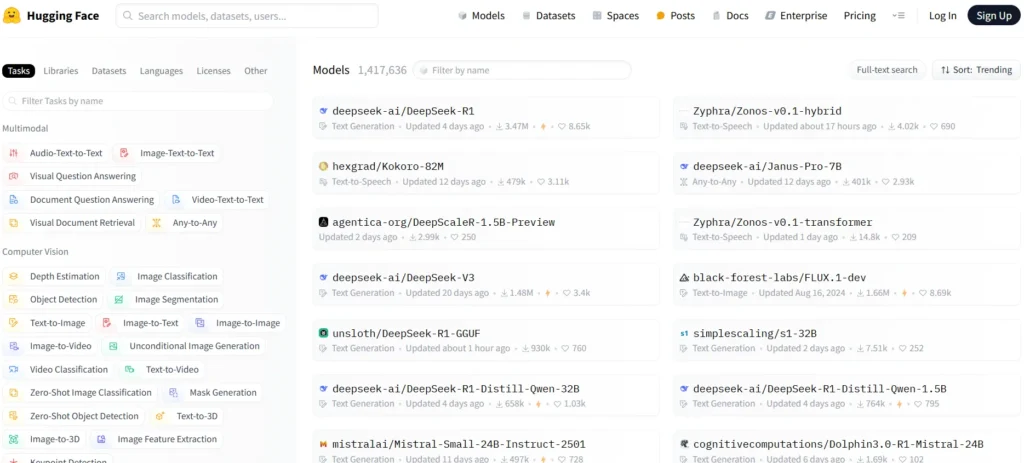

Modelos

A Hugging Face oferece uma imensa variedade de modelos pré-treinados, organizados por tipo de tarefa (NLP, visão computacional, reconhecimento de voz etc.), idioma, bibliotecas compatíveis e outros critérios. Graças à biblioteca transformers, é possível usar esses modelos para resolver desafios complexos sem precisar começar do zero.

Na plataforma, a busca por modelos públicos é intuitiva: basta usar os filtros à esquerda para refinar sua pesquisa. Por exemplo, você pode selecionar um modelo específico para análise de sentimentos em português ou para geração de imagens, economizando tempo e recursos.

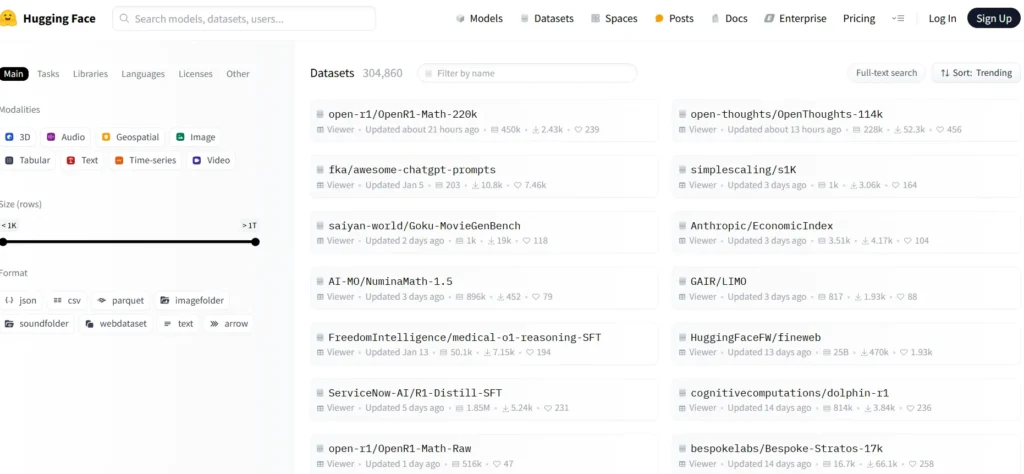

Datasets

Além dos modelos, a Hugging Face reúne uma coleção valiosa de datasets prontos para uso em projetos de machine learning. Essas bases de dados cobrem desde textos até áudios, imagens e informações geoespaciais, e são organizadas por categoria, tamanho e formato.

Assim como na seção de modelos, os filtros facilitam a busca. Ao escolher um dataset, é possível visualizar amostras dos dados, acessar o histórico de atualizações, ver comentários da comunidade e até copiar códigos prontos para importar a base diretamente para seu projeto. Esses recursos são ideais para fazer fine-tuning em modelos, ajustando-os às necessidades específicas do seu trabalho.

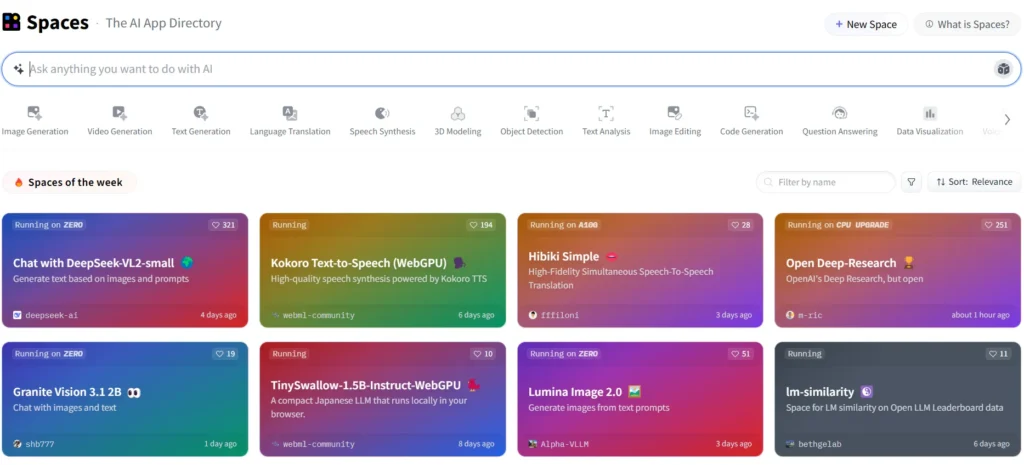

Spaces

Os Spaces são a parte mais interativa da plataforma: aqui, usuários criam e compartilham aplicações de IA em funcionamento, como chatbots, geradores de arte ou ferramentas de análise. Cada “app” exibe detalhes técnicos, links para o código-fonte e, em alguns casos, até publicações acadêmicas relacionadas.

Criar um Space é simples: escolha entre frameworks como Gradio ou Streamlit, adicione seu código e publique. A hospedagem é gratuita para projetos com até 16GB de memória, 2 CPUs e 50GB de armazenamento perfeito para protótipos ou para destacar seu trabalho no portfólio. E o melhor: qualquer app pode ser compartilhado via URL ou embutido em sites externos.

Por que a Hugging Face é relevante no campo da inteligência artificial?

A Hugging Face se destaca porque acredita que a inteligência artificial deve estar ao alcance de todos, não apenas dos especialistas. Afinal, a empresa tem como principal missão democratizar o acesso à IA, tornando as tecnologias avançadas acessíveis tanto para iniciantes quanto para profissionais experientes. Isso se reflete em seu compromisso com a abertura e a transparência, permitindo que desenvolvedores e pesquisadores compartilhem modelos e técnicas, o que, por conseguinte, acelera o avanço da área.

Além disso, outro ponto forte da Hugging Face é a sua vasta coleção de modelos pré-treinados, disponíveis por meio da biblioteca Transformers. Esses modelos, por exemplo, podem ser facilmente aplicados e adaptados para uma variedade de usos, eliminando a necessidade de treinamentos complexos e, assim, incentivando a inovação em diversos setores.

Analogamente, a plataforma funciona como um verdadeiro hub colaborativo, similar ao GitHub, onde pessoas podem compartilhar seus projetos, buscar inspiração e aprender com o trabalho dos outros. Essa comunidade ativa enriquece o ecossistema de IA e promove uma troca constante de conhecimentos e experiências.

Por fim, o apoio financeiro e as parcerias estratégicas reforçam a credibilidade e o potencial de crescimento da plataforma. Em conclusão, recentemente, a Hugging Face recebeu um investimento expressivo que elevou sua avaliação para US$ 4,5 bilhões, contando com o suporte de grandes nomes como Google, Amazon e Nvidia. Essas parcerias, sem dúvida, ampliam sua capacidade de inovação e expansão.

O que são os Transformers da Hugging Face?

Desenvolvida pela própria Hugging Face, a biblioteca Transformers é um conjunto de ferramentas e APIs de código aberto que facilita o uso de modelos pré-treinados. Esses modelos se baseiam na arquitetura Transformer, famosa por sua capacidade de lidar com sequências de dados como textos por meio de mecanismos de atenção que capturam relações complexas entre palavras e frases. Embora seja muito utilizada para tarefas de processamento de linguagem natural, a biblioteca também pode ser aplicada em áreas como visão computacional e áudio.

Principais características

- Modelos pré-treinados: com uma vasta coleção de modelos prontos para uso, a biblioteca permite que desenvolvedores e pesquisadores implementem soluções como análise de sentimentos, tradução automática e geração de texto sem precisar treinar um modelo do zero.

- Pipelines: uma funcionalidade superútil é o objeto pipeline, que já reúne as melhores práticas para várias tarefas. Isso torna a implementação muito mais simples, permitindo que você execute tarefas específicas com apenas algumas linhas de código.

- Integração com frameworks: compatível com frameworks populares como PyTorch e TensorFlow, a biblioteca se adapta facilmente ao ambiente de desenvolvimento que você já utiliza.

Aplicações

Os modelos disponíveis na biblioteca Transformers podem ser usados em diversas áreas, como:

- Classificação de texto

- Reconhecimento de fala

- Geração de texto

- Segmentação de imagens

- Conversão entre texto e imagem

Exemplo prático: análise de sentimentos

A grande vantagem da biblioteca é a facilidade de uso. Veja como é simples fazer uma análise de sentimentos com apenas algumas linhas de código:

from transformers import pipeline

classificador = pipeline("sentiment-analysis")

resultado = classificador([

"O Hugging Face é incrível!",

"Estou aprendendo muito, mas preciso de mais prática."

])

print(resultado)Nesse exemplo, importamos a função pipeline, criamos um classificador de sentimentos e, ao passar uma lista de frases, recebemos de volta uma análise com rótulos (como positivo ou negativo) e uma pontuação de confiança para cada uma delas.

Como usar a Hugging Face em Python?

Para começar a usar a Hugging Face em Python, você pode seguir alguns passos simples para configurar seu ambiente e trabalhar com modelos pré-treinados. Vamos ver como:

1. Configuração do ambiente

Instale o Python e o pip:

Certifique-se de que o Python 3.8 ou superior esteja instalado (lembrando que, se você usar o Python 3.4, ele já vem com o pip instalado). O pip, que é o gerenciador de pacotes do Python, também é essencial para instalar as bibliotecas da Hugging Face.

Instale as bibliotecas da Hugging Face:

Abra seu terminal ou prompt de comando e execute estes comandos para instalar a biblioteca Transformers e suas dependências:

pip install transformers

pip install tokenizers datasets2. Escolha do editor

Você pode usar o editor de código ou IDE que preferir, como o Jupyter Notebook, PyCharm ou Visual Studio Code. Uma dica importante é criar um ambiente virtual para isolar as dependências do seu projeto.

3. Usando modelos pré-treinados

A biblioteca Transformers torna o uso de modelos pré-treinados muito simples. Com ela, você pode realizar diversas tarefas como análise de sentimentos, tradução e reconhecimento de fala utilizando o método pipeline().

Exemplo: gerando texto com GPT-2

Veja um exemplo de como usar o modelo GPT-2 para gerar texto:

from transformers import pipeline

# Cria um pipeline para geração de texto

text_generator = pipeline("text-generation", model="gpt2")

# Frase inicial para a geração de texto

prompt = "Era uma vez em uma terra distante"

# Gera texto com base na frase inicial

generated_text = text_generator(prompt, max_length=100, num_return_sequences=1)

# Exibe o resultado

for i, text in enumerate(generated_text):

print(f"Texto gerado {i + 1}: {text['generated_text']}")Executando tarefas específicas

Você pode especificar diferentes tarefas com o pipeline(). Por exemplo, para realizar o reconhecimento automático de fala, use:

from transformers import pipeline

# Cria um pipeline para reconhecimento automático de fala

transcriber = pipeline(task="automatic-speech-recognition", model="openai/whisper-small")

# Transcreve um arquivo de áudio

result = transcriber("caminho/para/seu/arquivo_de_audio.wav")

print(result)Exemplo prático: geração de texto

Vamos ver como é fácil gerar texto com a Hugging Face usando um modelo pré-treinado.

from transformers import pipeline

# Criando um gerador de texto

gerador_de_texto = pipeline("text-generation")

# Gerando texto a partir de uma frase inicial

resultado = gerador_de_texto("Hoje é um dia ensolarado e eu quero", max_length=50)

print(resultado)Nesse exemplo, o modelo pega a frase inicial “Hoje é um dia ensolarado e eu quero” e continua a narrativa até atingir um comprimento máximo de 50 tokens. É interessante notar que a saída pode variar a cada execução, mostrando a criatividade do modelo.

Caso você queira gerar texto em outros idiomas, pode procurar modelos específicos para cada língua no hub da Hugging Face. Isso permite comparar os resultados e escolher o modelo que melhor se adapta às suas necessidades.

Exemplo prático: tradução de textos

A Hugging Face também torna simples a tradução de textos entre diferentes idiomas. Confira o exemplo a seguir:

from transformers import pipeline

# Criando um tradutor com um modelo específico para traduzir do inglês para o português

tradutor = pipeline("translation", model="Helsinki-NLP/opus-mt-en-pt")

# Traduzindo uma frase do inglês para o português

resultado = tradutor("Hello, how are you?", max_length=40)

print(resultado)Aqui, usamos o modelo Helsinki-NLP/opus-mt-en-pt para converter a frase “Hello, how are you?” do inglês para o português. Com apenas algumas linhas de código, você pode integrar traduções em suas aplicações e criar soluções multilíngues de forma rápida e prática.

IAs para Imagens e Áudio com Hugging Face

Comparação do Hugging Face com outras bibliotecas de PLN

Comparar a Hugging Face com outras bibliotecas de PLN pode ajudar a entender melhor o que cada uma oferece e como elas se destacam. Veja a seguir uma comparação direta entre a Hugging Face e outras ferramentas populares:

Hugging Face vs SpaCy

- Variedade de modelos:

Hugging Face se orgulha de seu enorme repositório de modelos pré-treinados (como BERT, GPT-2 e T5), o que facilita experimentar e implementar uma vasta gama de tarefas. Já o SpaCy oferece modelos mais específicos e otimizados para determinadas tarefas, como reconhecimento de entidades nomeadas (NER) e análise sintática, mas com uma variedade menor. - Facilidade de uso e experimentação:

Com a Hugging Face, você conta com uma API intuitiva e ferramentas como o pipeline, que tornam a implementação de diferentes tarefas muito simples, até para iniciantes. Por outro lado, o SpaCy é pensado para ser robusto e eficiente em ambientes de produção, o que pode exigir um pouco mais de configuração para experimentação rápida. - Foco e performance:

Se o seu objetivo é colocar algo em produção com rapidez e eficiência, o SpaCy é uma excelente escolha. Entretanto, se você busca flexibilidade para testar várias ideias e aproveitar a colaboração de uma comunidade ativa, a Hugging Face leva vantagem.

Gensim vs Hugging Face

- Escopo de aplicações:

Gensim é especializado em modelagem de tópicos e criação de word embeddings, como Word2Vec e FastText, sendo ideal para análises semânticas e similaridade entre textos. Em contrapartida, a Hugging Face oferece uma gama muito mais ampla de aplicações, desde geração e tradução de textos até tarefas mais complexas de NLP com modelos transformer. - Abordagem tecnológica:

Enquanto Gensim foca em métodos mais tradicionais de análise de texto, a Hugging Face está na vanguarda dos modelos de aprendizado profundo. Isso significa que, para tarefas que exigem o estado da arte, a Hugging Face geralmente oferece soluções mais modernas e eficientes.

Hugging Face vs TextBlob

- Simplicidade vs. avanço:

TextBlob é uma biblioteca muito simples e intuitiva, perfeita para quem precisa de soluções rápidas para tarefas básicas, como análise de sentimentos ou tradução simples. Por outro lado, a Hugging Face oferece acesso a modelos avançados (como GPT-2 e T5) que possibilitam a implementação de aplicações complexas e sofisticadas. - Limitações funcionais:

Se você precisa apenas de uma análise rápida e não planeja escalar ou personalizar muito sua aplicação, TextBlob pode ser suficiente. No entanto, para projetos que exigem maior flexibilidade, precisão e inovação, a Hugging Face se destaca com uma comunidade ativa e suporte contínuo para novas pesquisas e tecnologias.

Desbloqueie o poder da IA com a Hugging Face e Python!

Você já viu como a Hugging Face está revolucionando o acesso e o desenvolvimento da Inteligência Artificial. Agora, é a sua vez de dar o próximo passo nessa jornada incrível!

Se você ficou empolgado com o potencial da IA e deseja ir ainda mais longe, não perca a chance de explorar a Trilha Aplicações IA com Python na Asimov Academy. Essa trilha foi criada especialmente para levar você a um novo patamar no mundo da tecnologia.

Ao se inscrever, você aprenderá a programar em Python do zero. Mesmo que esteja começando agora, você dominará os fundamentos da lógica de programação de forma prática e envolvente. Além disso, você terá a oportunidade de entender os fundamentos da Inteligência Artificial. Descubra como essas tecnologias são criadas e desenvolvidas e como combiná-las com Python para desenvolver soluções inovadoras que podem transformar sua carreira.

Transforme seu conhecimento em projetos reais e impulsione sua carreira no mundo da Inteligência Artificial!

Trilha Aplicações IA com Python

Crie agentes autônomos combinando modelos de linguagem (como ChatGPT, DeepSeek e Claude) com Python.

Comece agora

Cursos de programação gratuitos com certificado

Aprenda a programar e desenvolva soluções para o seu trabalho com Python para alcançar novas oportunidades profissionais. Aqui na Asimov você encontra:

- Conteúdos gratuitos

- Projetos práticos

- Certificados

- +20 mil alunos e comunidade exclusiva

- Materiais didáticos e download de código

Comentários

30xp